如意大模型再升级!自由伸缩,端云接力,多模态能力全注入

还记得 app 请求“使用相机”权限时

脑海里闪过的一丝犹豫吗?

它会不会在不知情时,“看”得太多?

有没有一种技术

能让 AI “看见”危险

却又对隐私“视而不见”

TeleAI 创新设计的“隐私摄像头”

既能抹除敏感画面、守住隐私边界

还能精准、快速地识别出吸烟、跌倒、霸凌等危险行为。

背后到底是什么样的“黑科技”

能完美化解

隐私保护与精准识别

这个看似无解的两难?

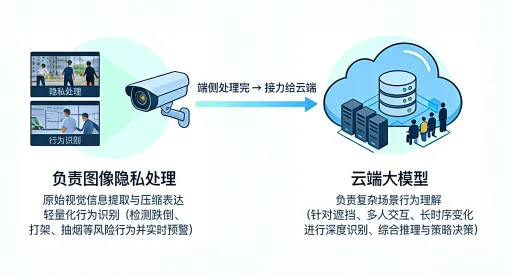

TeleAI 的解法是:端云协同,将模型能力拆分部署,让不同规模、不同形态的家族模型在端侧和云侧分工协作、各展所长。

端侧:主打“快”与“巧”

端侧模型在本地对视觉信息进行特征提取和压缩,利用低时延优势快速完成初步识别,实现实时响应与高效初筛预警。

云端:主打“深”与“难”

云端大模型接力处理端侧传来的数据,专门负责“啃硬骨头” 。面对复杂场景,它能充分发挥强大的多模态理解能力,开展深度识别、综合推理与最终的策略决策 。

端云协同模式背后的技术基座,正是中国电信集团 CTO、首席科学家、中国电信人工智能研究院(TeleAI)院长李学龙教授带领科研团队攻关的智传网(AI Flow)。

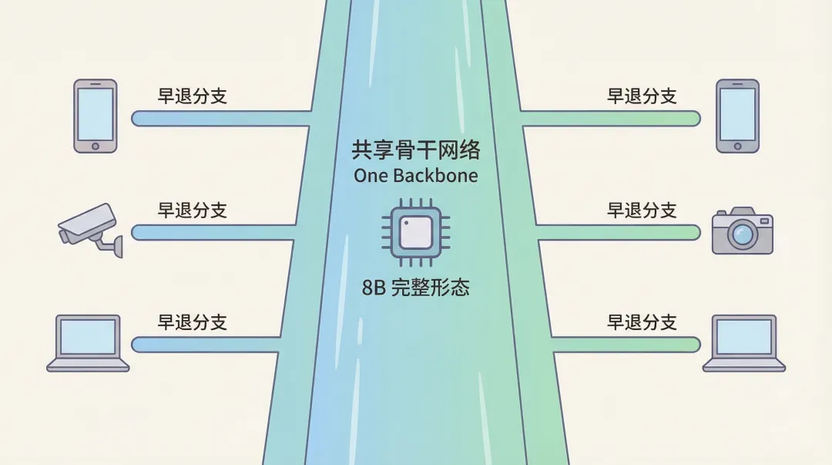

针对“不同尺寸,独立训练”的传统训练模式所导致的模型割裂与能力断层,TeleAI 科研团队基于智传网(AI Flow)“信容律、同源律、集成律”三大核心理论,创新构建了同源家族模型(Familial Model)——如意大模型。

近期,如意大模型正式发布最新版本——AI-Flow-Ruyi2.5 。相比上一代 Ruyi2, Ruyi2.5 实现了多模态能力体系的整体升级,训练效率实现进一步提升,大模型能力进一步比肩主流水准。

训练过程中,具备全量参数的 8B 模型作为完整形态,将其文本与视觉编码器下沉部署至端侧,并在端侧顶层引入“早退分支(Early Exit)”机制进行联合训练。

大模型的高阶能力得以自然沉淀并迁移到小模型身上,使整个家族模型在同一个语义空间中协同进化。

这种“一脉相承”的同源底层架构,让Ruyi2.5 打破了表征割裂,将联合理解能力全面拓展至文本、图像及复杂场景信息,实现多模态深度理解与复杂推理。

在多模态能力升级之外,Ruyi2.5 在底层强化学习训练算法上也实现了关键突破。

针对传统强化学习中样本冗余高、长序列反向传播成本大的问题,TeleAI 提出了二元前缀策略优化(Binary Prefix Policy Optimization, BPPO)算法。

科研团队通过实验发现,同组正确样本之间和错误样本之间的梯度高度相似,而正负样本之间的梯度差异更显著,因此 BPPO 在每轮训练中仅保留一个正样本和一个负样本作为代表响应参与更新,以减少样本冗余。

同时,考虑到自回归推理中前缀阶段更集中地决定问题理解与解题路径,后续内容更多是对既有思路的展开,BPPO 进一步将梯度更新聚焦于响应前缀,而非对整条长序列进行全量反传。

通过“正负代表样本筛选 + 前缀级更新”,BPPO 在保留关键学习信号的同时,成功让训练效率提升了约 2-3 倍。

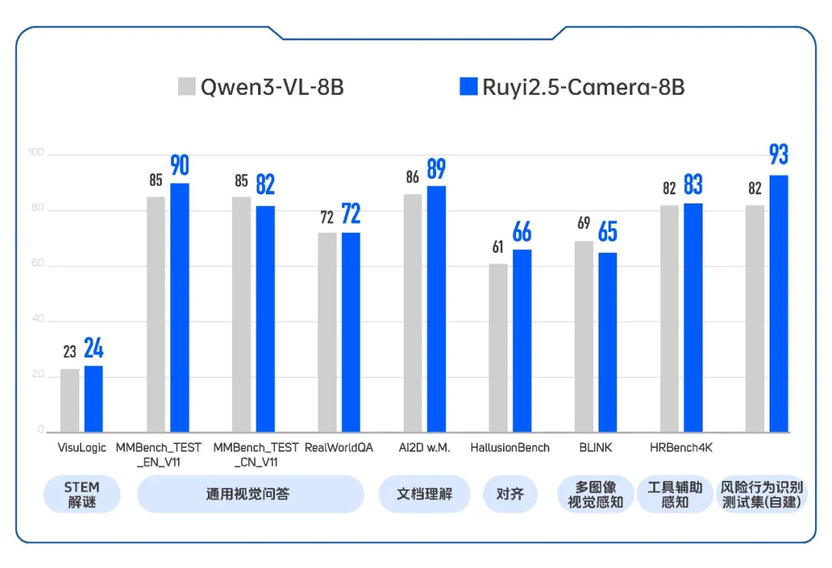

TeleAI 科研团队针对相机监控场景,在 Ruyi2.5 的基础上训练了 Ruyi2.5-Camera-8B 专项模型。

为了全面检验该模型的多模态理解能力,团队在多个权威测试集上对 Ruyi2.5-Camera-8B 进行了测试,评价维度涵盖科学推理、视觉问答、文档解析、多图关联、指令对齐及工具感知等。

此外,科研团队针对复杂视觉环境构建了一套高难度的风险行为评测集。该评测集涵盖了跌倒、打架、抽烟三类典型风险行为,每类精选大量挑战性样本,深度考量模型对细微动作及空间逻辑的理解能力。

评测数据表明,该模型在风险行为识别的关键指标上优于 Qwen3-VL,且在提升特定场景精度的同时,多模态通用指标依然保持稳健,实现了专项强化与通用性能的兼顾,具备极强的垂直行业落地价值。

从平衡隐私保护与精准识别

到端云协同家族模型的精准接力

如意大模型 Ruyi2.5 的升级

既是多模态理解的纵深拓展

也是智传网(AI Flow)的再一次进化

让大模型在自由伸缩的同时

在统一体系内默契配合

适配不同的算力资源需求

处理更多模态、更复杂的任务

为人工智能的规模化应用

提供更扎实、更可靠的技术底座

相关工作

H. Song, S. Tian, Q. Zhao, W. Hong, J. Liu, T. Long, J. Shao, X. Li*, "Ruyi2.5 Technical Report", arXiv:2603.17311.

H. Song, S. Tian, J. Hao, M. Xu, H. An, Y. Song, J. Shao, X. Li*, "Ruyi2 Technical Report", arXiv:2602.22543.

C. Yuan, J. Shao, X. Li*, "Information Capacity: Evaluating the Efficiency of Large Language Models via Text Compression", arXiv:2511.08066.

J. Shao and X. Li*, "AI Flow at the Network Edge", IEEE Network, vol. 40, no. 1, pp. 330-336, Jan. 2026, doi: 10.1109/MNET.2025.3541208.

H. An, W. Hu, S. Huang, S. Huang, R. Li, Y. Liang, J. Shao, Y. Song, Z. Wang, C. Yuan, C. Zhang, H. Zhang, W. Zhuang, X. Li*. "AI Flow: Perspectives, Scenarios, and Approaches", Vicinagearth 3, 1 (2026).