端到端一键编程!TeleAI 开源首个代码模型

是谁的 DNA 动了?

方向键一划,大鱼吃小鱼

这款轻松的小游戏

陪伴了很多人的闲暇时光

但想玩的时候又找不到?

不如自己生成一个!

不懂编程?没关系,只要把规则写清楚!

近日,中国电信人工智能研究院(TeleAI)与中电信人工智能科技有限公司正式开源星辰语义大模型首个代码模型 TeleChat3-Coder-36B-Thinking,根据自然语言描述就能快速生成各类应用程序。

例如上面“大鱼吃小鱼”的游戏,只要给出游戏界面的风格、交互规则、玩法说明等核心描述,TeleChat3-Coder-36B-Thinking 就能编写出完整的 HTML 代码。

不仅是小游戏,还能生成专属的“家庭健康档案”,定期记录家人的体重变化、血压指标等,守护全家的健康状况。

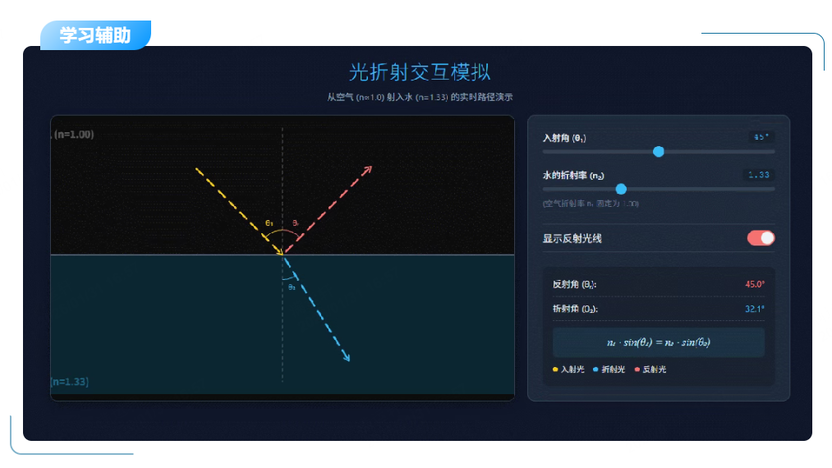

为了让孩子更高效地学习,不如生成一个“光的折射原理”,以形象化的方式展现知识点,还能通过交互方式模拟物理变化。

星辰大模型是中国电信集团 CTO、首席科学家、中国电信人工智能研究院(TeleAI)院长李学龙教授带领 TeleAI 科研团队自研打造的全模态、全尺寸、全国产大模型体系。TeleChat3 是星辰语义大模型的第三代版本。

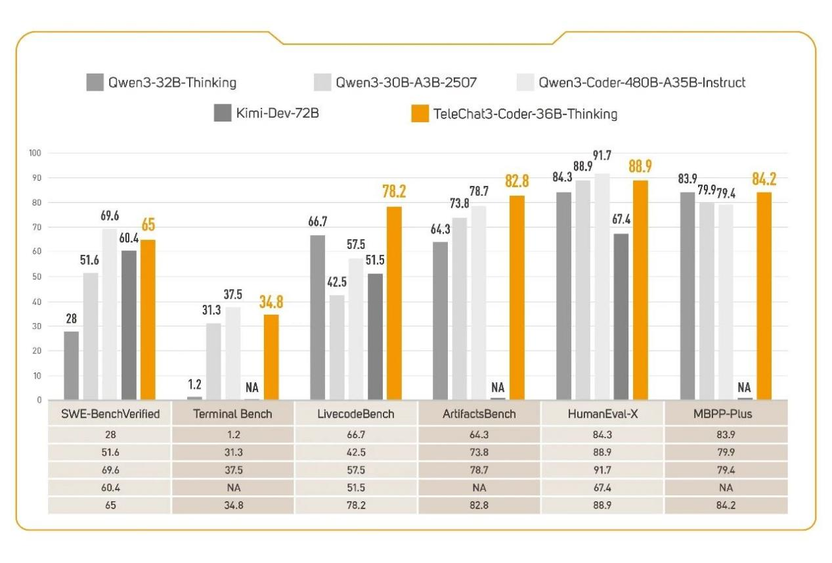

TeleChat3-Coder-36B-Thinking则基于TeleChat3基础模型打造,在代码综合能力上有优异表现。其性能在 SWE-bench Verified、HumanEval-X 等多个权威评测榜单中超越 Qwen3-32B,综合效果在同尺寸模型中达到最优水平。

不仅如此,该模型在 Agent 能力方面同样表现优异,在 BFCL 和 Tau2-Bench 榜单达到同级别参数领先水平。

TeleChat3-Coder-36B-Thinking 之所以能在各类场景应用中上达到如此好的效果和高准确率,是基于科研团队强大的模型训练策略。

在预训练阶段,TeleChat3-Coder-36B-Thinking 分为三个步骤:

在 TeleChat3 基础模型上增加代码数据比例进行持续训练,提升代码通识能力。

增加高质量仓库级别代码长文数据、SWE 级别长程代码任务数据,基于32K 上下文长度持续训练,增加模型长上文代码任务能力。

持续提升长程代码任务和智能体任务数据占比,基于 128K 上下文长度持续训练,提升模型在代码和智能体长程任务能力。

在后训练阶段,采用迭代式提升方案,经过冷启动微调、强化学习、长程任务微调优化、Agentic RL 优化,不断提升模型综合能力。

TeleAI 还搭建了上万个环境用于合成任务路径数据以及 Agentic RL 使用。为提升 Web Vibe Coding 效果,团队基于 GUI-Agent 搭建了一套可以自动操作 Web 界面进行评估生成效果的系统,大幅提升数据质量。

TeleChat 系列模型尺寸覆盖十亿到千亿

构建了全尺寸大模型开源布局

其中 TeleChat2-3B 和 TeleChat2-35B

在 Huggingface 下载量均已超过 10 万

TeleChat3-Coder-36B-Thinking现已正式开源

欢迎广大开发者实测、反馈

共同解锁更多技术可能

GitHub:

https://github.com/Tele-AI/TeleChat3-Coder

Huggingface:

https://huggingface.co/Tele-AI/TeleChat3-Coder-36B-Thinking

ModelScope:

https://modelscope.cn/models/TeleAI/TeleCoder3-36B-Thinking

魔乐社区:

https://modelers.cn/models/TeleAI/TeleChat3-Coder-36B-Thinking