生成式视频压缩:让远洋出海也能看一场完整的世界杯!

远洋出海的船员想看一场世界杯直播?

不存在的......可能除了球不转,整个画面都在打转......

在低带宽、弱网络环境下,“传得快” 和“看得清” 似乎永远是一道单选题——要么压缩后画面糊成一团,要么高清视频耗光带宽、加载半天。随着 VR、远程会议、无人机视频等应用的爆发,视频数据量呈指数级增长,这个“两难困境” 变得难上加难。

面对这样的痛点,中国电信集团 CTO、首席科学家、中国电信人工智能研究院(TeleAI)院长李学龙教授带领团队,以智传网(AI Flow)的信容律为理论基础,提出全新生成式视频压缩框架(Generative Video Compression - GVC)。

简单来说,就是跳出视频压缩的局限,用 AI 的“计算”,换传输的“带宽”。

在电视转播、视频通话、无人机航拍传输等场景,生成式视频压缩已展现出出色的传输稳定性,无论在海上还是山区,在那些信号覆盖不到的地方,让人们也能享受科技带来的便利。

用“计算”换“带宽”

让画面“轻轻地”重生

如果把视频传输比作“分享一幅画”。

传统压缩是“把画拍下来,尽量缩小照片体积再发出去”,结果就是越压缩,细节越模糊。

而 TeleAI 提出的生成式压缩,则是只告诉对方构图、色彩、风格这些关键信息,让 AI 画家现场还原这幅画。

这一过程中,生成式压缩方案把原始视频先转换成高度抽象的“语义信息+运动动态”,再把抽象信息传输到接收端,接收端以这些抽象信息为条件,依托多模态生成模型的先验知识,去生成复原出跟原始视频高度一致的视频。

传输的过程中,占用带宽大大减少,网络延迟大大降低。

在权威数据集 MCL-JCV 测试中,GVC 的极端压缩率可达 0.005 bbp(对应 0.02% 压缩率),且能保持优异的视觉质感与语义传递能力,传统压缩技术(如 HEVC)需 6 倍以上带宽,才能达到同等效果。

“感知质量 + 任务有效性” 双权衡

传输效果好才是“王道”

以往传输视频,往往依赖 HEVC、VVC 这类传统视频编码技术。但这些技术更看重 “数据保真”—— 力求保留每个像素的原始信息,却忽略了更核心的传输诉求:要么是人眼看得舒服,要么是机器能准确识别信息。

TeleAI 提出的生成式智能压缩,则创新实现了“感知+任务导向”模式。若面向人类感知,则传输“画质感知”导向的特征;若面向机器理解(如分割、跟踪),则传输 “语义有效”的相关表示,支持下游任务高效准确完成。

“极限”不能留在实验室

能落地才是真本事

GVC 通过模型小型化、知识蒸馏和量化等技术提升计算效率,通过 “压缩率 - 计算量” 的灵活权衡,让消费级 GPU 也能实现低延迟推理,真正落地实用。

在实际应用中,GVC 尤其适配带宽稀缺、资源受限的关键场景:无论是海事通信中依赖窄带卫星的视频传输,应急救援时带宽紧张的画面回传,还是远程视频监控、低带宽移动网络下的视频流转,甚至是车载设备、可穿戴设备等边缘终端的轻量化视频传输需求,它都能提供高效的解决方案。

这不仅突破了视频压缩的技术极限,更重新定义了通信的本质——只传输感知与决策所需的核心信息,为高效、自适应、智能化的下一代视频通信铺平了道路,也为生成建模与通信技术的交叉创新提供了全新方向。

One More Thing

生成式视频压缩是在智传网(AI Flow)信容律理论支撑下的应用实践之一。信容律与同源律、集成律共同构成智传网(AI Flow)的理论体系,它主要描述大模型的本质规律,通过数据压缩的方式来衡量模型的知识密度,也就是智能能力。

同源律则展现大模型的“部分”与“整体”关系,在相同训练计算开销下,能指导得到数量更多、性能更好的不同大小的家族模型。集成律能指导大模型“单体”与“群体”的协同,通过多个模型集成的方式,实现智能能力的提升与涌现。

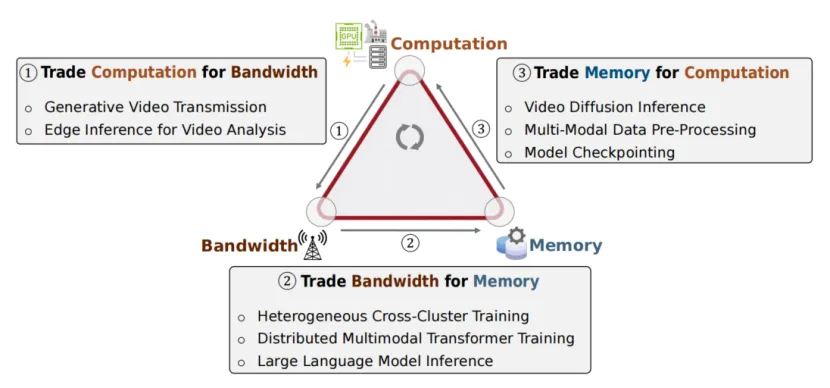

大模型的快速发展正在重新定义人机协作的范式,同时也暴露出硬件架构的局限,体现为“计算效率、互连带宽、内存容量”三方制约,任何单一维度的提升往往会加剧其他维度的瓶颈。为此,TeleAI 还提出一套全新的AI 基础设施资源置换理论框架,通过算法与系统的协同设计,实现算力、存储、网络资源的动态权衡,推动智能的绿色高效发展。

此框架是国际首个系统性提炼“计算–带宽–内存”三种资源在 AI 时代的资源置换回路:

用计算换带宽:在带宽受限时利用计算资源减少数据传输。

用带宽换内存:在本地存储资源不足时借助充沛通信能力填充或刷新内存。

用内存换计算:在计算成本过高时利用存储容量避免冗余运算。

通过这样的交换机制,“计算–带宽–内存”形成三位一体的协同体系,在多种真实 AI 场景的初步测试中,已展现出显著的实际价值。

无论是手机与云端联动的智能处理、超大规模 AI 模型训练,还是高并发在线 AI 服务,均能切实降低运行成本、提升系统效能,真正实现人工智能系统的降本增效。

相关工作:

Xiangyu Chen, Jixiang Luo, Jingyu Xu, Fangqiu Yi, Chi Zhang, Xuelong Li, “Generative Video Compression: Towards 0.01% Compression Rate for Video Transmission”.

Yuankai Fan, Qizhen Weng and Xuelong Li, “Computation-Bandwidth-Memory Trade-offs: A Unified Paradigm for AI Infrastructure”.

Cheng Yuan, Jiawei Shao, Chi Zhang, Xuelong Li, “Information Capacity: Evaluating the Efficiency of Large Language Models via Text Compression”, arXiv:2511.08066.

Huan Song, Qingfei Zhao, Ting Long, Shuyu Tian, Hongjun An, Jiawei Shao, Chi Zhang, Xuelong Li, “Theoretical Foundations of Scaling Law in Familial Models”, arXiv:2512.23407.

Dakuan Lu, Jiaqi Zhang, Cheng Yuan, Jiawei Shao, Chi Zhang, Xuelong Li, “The Law of Multi-Model Collaboration: Scaling Limits of Model Ensembling for Large Language Models”, arXiv:2512.23340.